在 2024 年 10 月下旬著名的 AI 產圖模型 Stable Difussion 3.5 釋出後,測試覺得效果不錯,但沒有 Flux.1 他們的精緻,在陸續幾天測試後,有了一點心得,講一下它的產製效果感想。

之前於 2024 年 6 月時, SD 官方,也就是Stability AI,推出了 SD 3 ,而給外界下載的免費社群版本 (20億參數) 實在是慘不忍睹,生成的手指變形、身型很奇怪,並且沒辦法按照提詞正確生圖,問題不少。

如今,SD 3.5 有算是洗刷之前 SD3 的污名,呈現的成果是滿能讓社群接受與精進打磨的。但以現在 AI 生圖,AI產圖社群的活耀程度來看,離開 SD 團隊另起爐灶的 Flux AI 產圖模型,似乎受到更多人歡迎,而使用 SD 3.5 的人們正迎頭追上一點,主要是它的模型訓練成本會比 Flux.1 它們要低些。

SD 3.5 目前釋出給市場使用的是 Stable Diffusion 3.5 Large(8B,80億參數)及Stable Diffusion 3.5 Large Turbo(8B)。也有更小的版本 Stable Diffusion 3.5 Medium,但我覺得實際用起來,還是拿 SD 3.5 Large 或 SD 3.5 Large Turbo 用即可。

Stable Diffusion 3.5 Large 是多模態擴散Transformer(MMDiT)文字轉圖片模型,有採用預訓練固定式text encoder,並藉由QK-normalization方法提高模型訓練的穩定性。

Stable Diffusion 3.5 Large Turbo 是加上對抗性擴散蒸餾(adversarial diffusion distillation)方法的縮小版本,可以用更少的推論步數來產圖。

我自己使用 ComfyUI 來使用 Stable Diffusion 3.5 Large ,載入模型大概會吃掉4XGB的記憶體,至於顯示卡的 VRAM 耗用則是看圖片大小來決定,16GB 也是常會用滿。

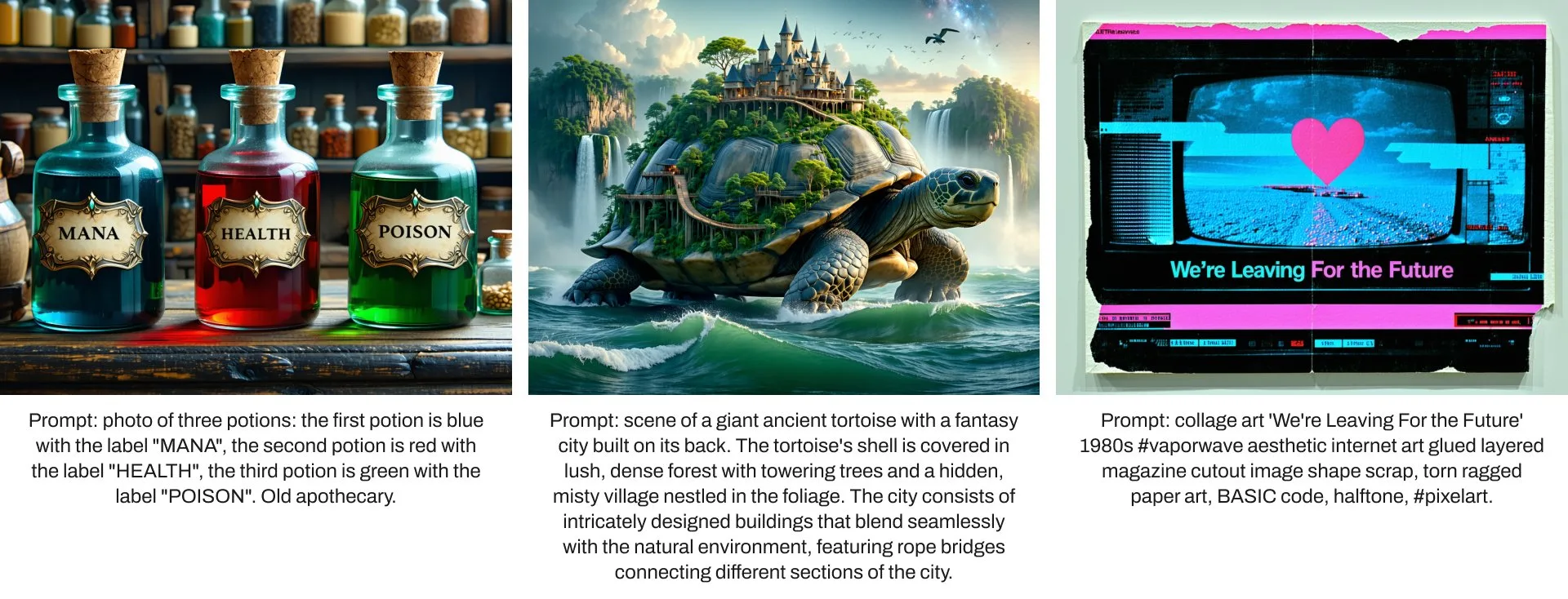

穩定產出喜歡的圖片,以及採用自己的照片們做訓練,透過線上平台的GPU來處理是滿好的方式。SD 3.5 只要提詞和搭配用的檔案有處理好,同樣也能生出讓人可以接受的圖像來。比方說我喜歡高額頭閃光她的迷人模樣,因此產出這樣的圖片來說也不意外: